游民星空 > > 正文

阿里达摩院上线文本生成视频大模型 仅支持英文输入

2023-03-22 18:15:56 来源:微博 作者:财经网 编辑:益达兄 浏览:loading

据财经网报道,阿里达摩院已在AI模型社区“魔搭”ModelScope上线了“文本生成视频大模型”。

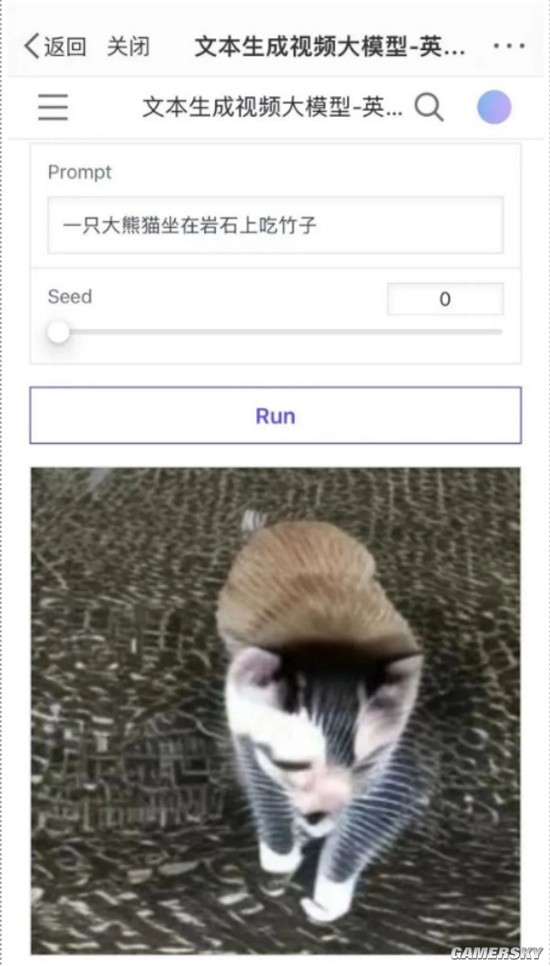

根据介绍,整体模型参数约17亿,目前只支持英文输入。扩散模型采用Unet3D结构,通过从纯高斯噪声视频中,迭代去噪的过程,实现视频生成的功能。

记者发现,这个模型目前已经开放给用户试玩,只要输入一些简单的描述词,就可以看到生成的视频效果。比如输入“A panda eating bamboo on a rock”,就可以看到一只大熊猫坐在岩石上吃竹子的画面。

不过,目前这个模型还不支持中文输入,而且生成的视频长度多在2-4秒,等待时间从20多秒到1分多钟不等,画面的真实度、清晰度以及长度等方面还有待提升。

据了解,“魔搭”是阿里达摩院联手CCF开源发展委员会在2022云栖大会推出的AI模型社区,首批开源模型超过300个,包括视觉、语音、自然语言处理、多模态等AI主要方向。

休闲娱乐

-

女生穿比基尼为什么不怕走光 给女儿买5090的囧图

女生穿比基尼为什么不怕走光 给女儿买5090的囧图

合同已谈妥!斗鱼官宣LOL世界冠军中单回归复播

合同已谈妥!斗鱼官宣LOL世界冠军中单回归复播

-

91岁杨老头弃坑《生化危机7》!直言:不吓自己只想快乐

91岁杨老头弃坑《生化危机7》!直言:不吓自己只想快乐

彻底沦陷!《007》性感女郎被评年度最佳女孩

彻底沦陷!《007》性感女郎被评年度最佳女孩

-

PS5独占《漫威金刚狼》售价曝光!疑似即将开启预购

PS5独占《漫威金刚狼》售价曝光!疑似即将开启预购

你卖原味是哪部位的原味?前凸后翘且中空的囧图

你卖原味是哪部位的原味?前凸后翘且中空的囧图

综合热点资讯

- 日本女星在家常裸体!自曝常被建筑工人看光

- 彻底沦陷!《007》性感女郎被评年度最佳女孩

- 涩到没边!Jennie超大尺度美照:只手遮酥胸 太劲

- 又一个B站百大UP主倒下了

- 敖厂长复活向观众道歉 自述翻车经历 网友支持改过

- 《神鬼寓言4》突然变成人3A!尺度大真能逆天改命?

- 突发!Xbox官宣《神鬼寓言》跳票!2027年2月发售

- 云南女博主哈尼小微被虫咬后感染去世:年仅39岁

- 为了黑丝得入《007》了 就好这一口!

- 知名演员刘洵去世 享年87岁:曾出演《九品芝麻官》

单机游戏下载

- 《007初露锋芒》官方正版下载

- 《极限竞速:地平线6》官方中文版下载

- 《深海迷航2》官方抢先体验版下载

- 《魔法门:上古纪元》官方抢先体验版下载

- 《哥布林维克:窃贼大亨》官方正版下载

- 《Team Principal: A Racing Manager》官方正版下载

- 《BAZOOKA: Rhythm Game》官方正版下载

- 《八号窗口:千禧年》官方中文版下载

好物推荐

-

发布时间:2026-05-29

-

发布时间:2026-05-29

-

发布时间:2026-05-29

游民星空联运游戏