假想何时能实现?探讨游戏中的人工智能

机器人三定律

假设人类的科技发展到足以制造和人类等同的人工智能,那么它们是否会对人类本身造成威胁?对于这一问题的答案,大体就如同外星人是否会和人类和平相处一样,偏向于哪一方的意见都存在,也无法简单二分,不同思想交织下诞生出了多样化风格的作品。但多数情况下,人们都承认人工智能相对于人类本身有着明显优势,和不可控的外星生命不同,对于亲自创造的人工生命大可以防微杜渐地加上限制,在这个基础上让故事中描述的社会结构更充满张力。

这些限制,或者说规则在不同作品中有不同体现,最出名的则是科幻大师阿西莫夫的机器人三定律:一、机器人不得伤害人,也不得见到人受到伤害而袖手旁观;二、机器人应服从人的命令,但前提不得违反第一定律;三、机器人应保护自身的安全,但前提不得违反第一及第二定律。而之后他本人又补充了第零定律,将人的概念扩展到人类整体,后来的科幻作家更是随着认知发展,不断对其进行修补,但通常说起机器人三定律还是这最初的描述,也是大家熟知的一套说法。具体应用出来的结果就例如以下情况,你命令机器人去杀人(包括你自己在内),它不会执行,但你命令机器人去自杀,它会完成。

机器人三定律所以出名倒并非大家默认它是什么金科玉律,真规定创作必须遵守这个的话许多游戏就压根不成立了……而是阿西莫夫利用这几点提出了一个相对严禁而又灵活的体系,让他的系列作品能在这个基础上更好地描述人类和人工智能之间的种种关系,即依赖又排斥,想利用又防范,比起单纯将机器人描写成工具仆人,或是杀戮怪物都来得更为复杂,也更有话题性。

然而,机器人三定律毕竟也只是从人类角度出发的一个理想化结果,希望能让人工智能持续为自己服务而不会反客为主,更多作品还是免不了把二者描述成竞争排斥的关系,甚至必须你死我活,从《终结者》到《黑客帝国》多少都体现了这一点,人类始终警惕在智能上能和自己等同,甚至超越自己的其他个体,这不光是客观上的必然事实,更是主观上的心理暗示,生命本身到底如何定义?思维是否有不可取代的特别性?

(如果机器人真的不得伤害人类,很多经典作品如终结者从一开始就不会成立。)

记忆和人格,思维和灵魂

1968年,另一位科幻大师克拉克的经典小说兼同名电影《2001太空漫游》故事设想中,2001年的人类已经能够制造超级人工智能HAL-9000,当时许多顶极AI研究者确实相信到2001年这样的机器会出现,而同期的另一篇科幻小说却认为人类要到下个世纪中期才有望登月——今天我们已经知道仅仅一年后美国人就把人送上了月球,但人工智能现在也看不到任何迹象。

事实上,持悲观态度的学者大多认为在现有计算机模型基础上,不论如何增加都不可能由量变引发质变,使得机器产生智能,更进一步来说,他们甚至拒绝承认符合定义的人工智能可能被制造出来,计算机永远只能完成信号的输入和输出,这一过程无法产生自我思考。在这个基础上,对人工智能的研究进一步分化成“强人工智能”和“弱人工智能”。后者是目前研究的主流方向,希望机器只需能够完美执行人类安排的每一项命令,不需要理解其中含义,也不需要产生额外判断。前者则是更进一步的情况,机器能够自我学习,理解进化,最终形成和人类一模一样的思考方式,甚至产生自我意识,和人类走上不同的发展方向。

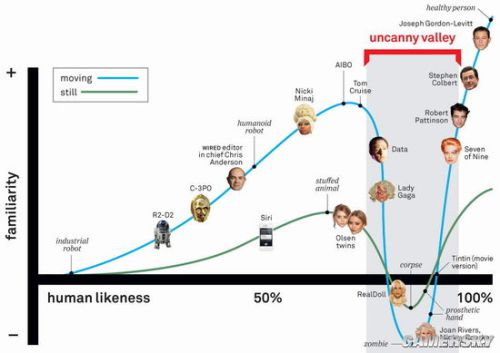

而如何判断人工智能是否拥有自我意识,同样是个富于争议性的话题,从本质上来说也是人类对自身存在的一个判断,记忆和人格,思维和灵魂,到底是一体两面,还是独一无二的存在,这并不是如同艺术作品那样用爱,用感情,用眼泪笑容就能交待过去的东西,即便是某个AI真的如开头所说,通过了图灵测试,那么在一般人的评价中,就能认可它确实具备和人类一样的思考方式吗?相信绝大多数人还是无法接受的,更不会将人工智能视为和自己对等的存在,包括许多人或许幻想过的人形机器人在内,若真的出现身旁,或许第一时间所感受到的也并非亲切而是恐惧。

(恐怖谷理论指出,和人类相似到一定程度的外形会率先产生排斥感,机器人也不例外)

至少,从现阶段来说,不管是哪一方的研究都和理想情况相差甚远,担心人工智能什么时候进化出天网或者矩阵准备灭绝人类,并不会比担心外星人某天打过来更有真实感,只是从科技本身的发展进程来看,这一目标只要确实有希望,就早晚有接近的一天,一如对外太空,对生命基因,对宇宙本身的探索一样。

-

《全面战争:中世纪3》公布!已进入早期开发阶段

《全面战争:中世纪3》公布!已进入早期开发阶段

一夫一妻制所以让老婆找老婆 这裙子有点短的囧图

一夫一妻制所以让老婆找老婆 这裙子有点短的囧图

-

外媒给《八方旅人0》打满分!野心与满足的完美绽放

外媒给《八方旅人0》打满分!野心与满足的完美绽放

国产开放世界《逆神者》首曝:东方文化结合蒸汽朋克

国产开放世界《逆神者》首曝:东方文化结合蒸汽朋克

-

《巫师3》终极Mod!修复5750个Bug 加入删减内容

《巫师3》终极Mod!修复5750个Bug 加入删减内容

禁止办公室恋情实则禁止偷情 慌乱之下穿错衣服的囧图

禁止办公室恋情实则禁止偷情 慌乱之下穿错衣服的囧图

- 又塌房?B站百大UP被集体曝光欺诈!抽奖5年不发奖

- 内容是有多成人?这款恐怖游戏被Steam\Epic双封杀!

- 硬件情报站:NV或取消显存捆绑 能煮面的游戏PC现身

- “小明剑魔结婚”引热议:可怜之人必有可恨之处

- 《FF7》爱丽丝演员被迫接收"露骨"内容!呼吁尊重隐私

- 国产开放世界《逆神者》首曝:东方文化结合蒸汽朋克

- 47岁吴建豪暴瘦40斤 身高1米8仅100斤吓坏网友

- 张朝阳再谈4小时睡眠法:已坚持8年 精力越来越好

- 刘强东父母现身京东食堂做饭 二老衣着朴素

- 卡普空公布《怪猎荒野》10条优化改动:12月上线!

- 《Hidden Cats in Spooky Town》官方正版下载

- 《百阳师》官方中文版下载

- 《万言堂代笔工房》官方中文版下载

- 《唱舞星计划》官方中文版下载

- 《数码宝贝世界:Next Order》官方正版下载

- 《银河文明4》官方中文版下载

- 《月球任务》官方中文版下载

- 《机甲战士5:氏族》官方中文版下载

-

发布时间:2025-12-05

-

发布时间:2025-12-05

-

发布时间:2025-12-05